Som borgere, fagfolk og forbrukere har vi et ansvar for å tenke over hvilke KI-verktøy vi bruker. Vi trenger ikke boikotte alt. Men vi kan velge bevisst.

Fredag 27. februar skjedde noe som burde få alle som bruker KI i arbeidet sitt til å stoppe opp og tenke.

Etter måneder med forhandlinger nektet Anthropic – selskapet bak KI-modellen Claude – å fjerne to klausuler fra sin kontrakt med Pentagon: et forbud mot masseovervåking av amerikanske borgere, og et krav om menneskelig kontroll over autonome våpensystemer. Pentagon hadde krevd at Anthropic skulle gi militæret tilgang til sine modeller for «all lovlig bruk» («all lawful use») – uten begrensninger.

Torsdag kveld publiserte Anthropics administrerende direktør Dario Amodei et offentlig brev der han forklarte hvorfor selskapet ikke ville bøye seg: «Vi kan ikke med god samvittighet gå med på deres krav.»

Likevel var ikke Pentagon villig til å akseptere at et privat selskap satte betingelser.

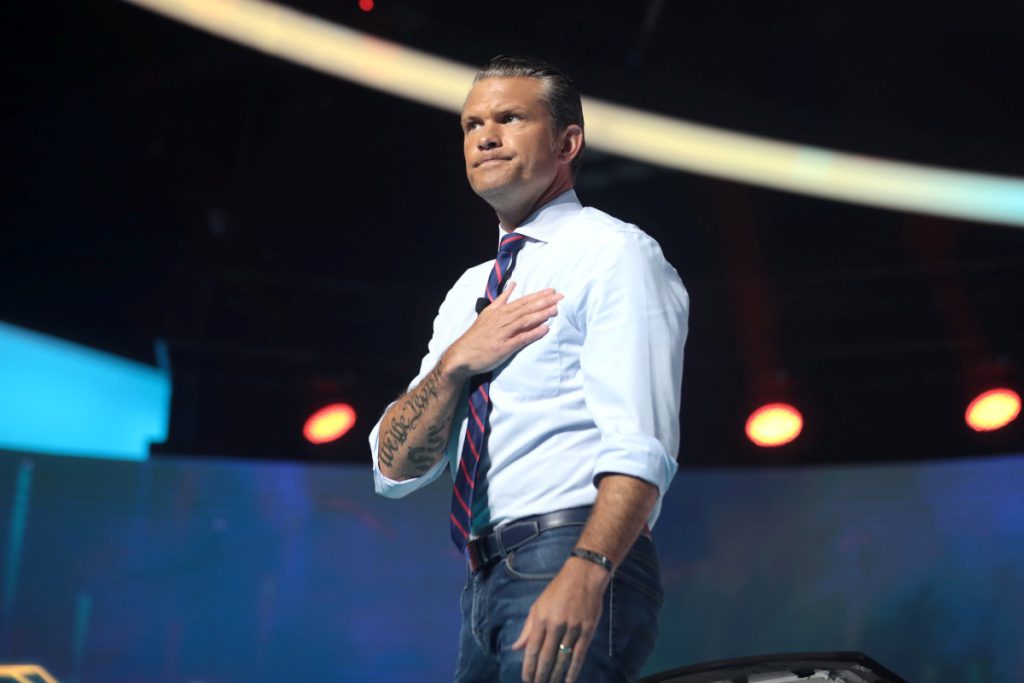

Fredag morgen, ifølge The Atlantic, fikk Anthropic beskjed om at Hegseths team ville komme med en vesentlig innrømmelse. Men da detaljene kom fredag ettermiddag, viste det seg at Pentagon fortsatt ønsket å bruke Anthropics KI til å analysere masseinnsamlet data fra amerikanske borgere – inkludert søkehistorikk, GPS-bevegelser, kredittkorttransaksjoner og andre personlige data, alt krysskoblet til et samlet bilde av den enkeltes liv. For Anthropic var det et brudd med alt de sto for, og forhandlingene brøt sammen.

Trump-administrasjonen slo tilbake med full kraft. Trump beordret alle føderale etater til å avvikle bruken av Anthropics teknologi. Forsvarsminister Pete Hegseth gikk enda lenger: han erklærte Anthropic som en «risiko i forsyningskjeden for nasjonal sikkerhet» («Supply-Chain Risk to National Security») – en betegnelse som normalt er forbeholdt fremmede stater og motstandere som Huawei. Amodei bekreftet i et intervju like etter at betegnelsen aldri tidligere har blitt brukt mot et amerikansk selskap: «Så vidt vi vet har denne betegnelsen aldri blitt brukt mot et amerikansk selskap. Den har bare blitt brukt mot motstandere – kinesiske brikkeprodusenter, russiske cybersikkerhetsselskaper.»

Timer senere annonserte OpenAI – selskapet bak ChatGPT – at de hadde inngått en avtale med Pentagon om å ta over på deres klassifiserte nettverk.

Det er verdt å la det synke inn.

Hva handler dette egentlig om?

Vi er i 2026, og kunstig intelligens er ikke lenger et teknologisk kuriosum. Det er infrastruktur. Det er verktøy som brukes daglig av hundretusenvis av nordmenn – lærere, studenter, forskere, journalister, byråkrater, advokater, leger, konsulenter. Vi betaler abonnementer, vi legger inn faglig innhold, vi stoler på disse systemene som arbeidsverktøy.

Men spørsmålet om hvem som eier disse verktøyene, hvilke verdier de er bygget på, og hvem de til syvende og sist betjener – det spørsmålet har aldri vært mer aktuelt enn nå.

Det er fristende å se dette som en kommersiell tvist mellom et teknologiselskap og dets største kunde.

Anthropic hadde bare to røde linjer i sin Pentagon-kontrakt: ingen bruk av KI til masseovervåking av egne borgere, og menneskelig kontroll over livsavgjørende beslutninger i autonome våpensystemer. Modellen deres – Claude – var allerede den eneste ledende KI-modellen som var klarert for bruk på Pentagons klassifiserte nettverk.

Pensjonert general Jack Shanahan, tidligere leder for Pentagons KI-initiativer, beskrev Anthropics betingelser som «rimelige» og pekte på at Claude har bredere og dypere utbredelse i det amerikanske militæret enn noe alternativ. Gregory Allen ved Center for Strategic and International Studies bekreftet at Anthropics begrensninger aldri hadde blitt utløst i praksis – at de aldri faktisk hadde hindret et eneste militært oppdrag.

Likevel var ikke Pentagon villig til å akseptere at et privat selskap satte betingelser. I Pentagons øyne handler det om et prinsipp: «Du kan ikke lede taktiske operasjoner basert på unntak,» som en Pentagon-tjenestemann forklarte det. Lovligheten er Pentagons ansvar som sluttbruker, ikke selskapets.

«Når vi forsvarer oss mot våre autokratiske motstandere, må vi gjøre det på måter som forsvarer og bevarer våre demokratiske verdier.»

Og om den tekniske realiteten: «Dagens KI-systemer er ikke i nærheten av pålitelige nok til å lage fullt autonome våpen. Det er en grunnleggende uforutsigbarhet ved dem som vi rent teknisk ikke har løst.»

Ikke bare et næringslivsdrama – et demokratisk varsel

Det er fristende å se dette som en kommersiell tvist mellom et teknologiselskap og dets største kunde. Men reaksjonene fra alle kanter av det politiske spekteret i USA tyder på at noe dypere er i spill.

Dean Ball var Trumps egen seniorrådgiver for kunstig intelligens – altså ikke noen venstreradikal kritiker. Han beskrev administrasjonens tiltak mot Anthropic som «forsøk på bedriftsdrap» og «et psykotisk maktgrep» som han mente var «nesten helt sikkert ulovlig». Han la til at han ikke kunne anbefale noen å investere i amerikansk KI eller å starte et KI-selskap i USA. Og videre: «Den amerikanske forbundsregjeringen er nå, med svært god margin, den mest aggressive regulatoren av kunstig intelligens i verden.»

Trumps egen retorikk bekrefter mønsteret.

Dette er ikke en demokrat som raser mot Trump. Det er en mann fra Trumps eget apparat som ser det samme mønsteret som mange av oss i Europa har sett vokse frem: bruken av statsmakt for å tvinge private aktører til å bøye seg.

Mark Dalton ved R Street Institute – en konservativ tenketank – pekte på en grell selvmotsigelse: bare dager før hadde Pentagon vurdert å bruke en krigsøkonomilov (Defense Production Act) for å tvinge Anthropic til å fortsette samarbeidet fordi teknologien var for viktig for nasjonal sikkerhet. Så snudde de 180 grader og erklærte det samme selskapet som en trussel mot nasjonal sikkerhet. Dalton advarte om at neste gang denne betegnelsen brukes mot et selskap med faktiske forbindelser til en fremmed makt, vil den ha mistet sin troverdighet.

Senatorene Ed Markey og Chris Van Hollen – i et brev til Hegseth – kalte Pentagons fremgangsmåte «et ekstraordinært og dypt alarmerende maktmisbruk» og påpekte at administrasjonen allerede bruker føderale overvåkingsverktøy til å dempe ytringsfrihet og undertrykke dissens. Senator Mark Warner, nestleder i etterretningskomiteen, stilte det nøkterne spørsmålet om nasjonale sikkerhetsbeslutninger nå drives av grundig analyse eller politiske hensyn.

Og her kommer den detaljen som gjør hele historien enda mer avslørende.

Amodei selv, i et intervju gitt rett etter Trumps kunngjøring, beskrev administrasjonens handlinger som «enestående inngrep i den private økonomien» og sa: «Å være uenig med myndighetene er det mest amerikanske i verden, og vi er patrioter i alt vi har gjort her.» Han var tydelig på hva han mente var motivasjonen: å skape «frykt, usikkerhet og tvil.» Men han nektet å la det lykkes.

Det er verdt å merke seg at da administrasjonen slo til, hadde det ennå ikke blitt gitt noen formell juridisk beskjed til Anthropic. Som Amodei selv sa: «Vi har ikke mottatt noen som helst formell informasjon. Alt vi har sett er tweets fra presidenten og tweets fra forsvarsminister Hegseth.» Politikk via sosiale medier, med milliarder av dollar og demokratiske prinsipper i potten.

Trumps egen retorikk bekrefter mønsteret. Han kalte Anthropic «venstreradikale galninger» og et «radikalt venstreorientert, woke selskap.» Han truet med å bruke «presidentembetets fulle makt» for å tvinge dem til underkastelse. Viseforsvarsminister Emil Michael kalte Amodei «en løgner» med «et gudekompleks.» Formuleringene ligner mer på trusler mot en politisk motstander enn på kontraktsforhandlinger mellom en stat og en leverandør.

Anthropic har varslet at de vil utfordre betegnelsen i retten, og hevder den er juridisk uholdbar og setter en farlig presedens for ethvert amerikansk selskap som forhandler med staten. Amodei har også påpekt at Hegseths påstand om at alle forsvarsleverandører må kutte båndene til Anthropic går langt utover det loven faktisk gir hjemmel for ved en «risiko i forsyningskjeden»-betegnelse.

OpenAI: den villige partneren

Og her kommer den detaljen som gjør hele historien enda mer avslørende.

Timer etter at Anthropic ble utestengt, annonserte OpenAI-sjef Sam Altman at selskapet hadde inngått en avtale med Pentagon. Altman hevdet at avtalen inneholdt nøyaktig de samme begrensningene som Anthropic hadde blitt straffet for å insistere på – forbud mot masseovervåking og krav om menneskelig kontroll over våpenbruk.

Men bare en time etter Altmans kunngjøring, korrigerte Pentagons viseminister Jeremy Lewin at OpenAI-kontraktens vilkår flyter fra prinsippet om «all lovlig bruk» – altså nøyaktig det Pentagon krevde av Anthropic og som Anthropic nektet å akseptere.

Man kan selvsagt endre mening.

Som det libertarianske tidsskriftet Reason lakonisk bemerket: OpenAI fikk kontrakten med det som ser ut som identiske vilkår – bare at Pentagon beholder den reelle kontrollen.

The Atlantic avslører en enda mer ubehagelig detalj. Tidligere i uken hadde Altman offentlig uttrykt solidaritet med Anthropics standpunkt. I et internt notat til sine ansatte, som NBC fikk tilgang til, skrev han at OpenAI ville ha fulgt Anthropics tilnærming i samme situasjon. Men mens han sa dette, forhandlet han allerede med Pentagon om å overta kontrakten. Anthropic hadde grundig vurdert – og forkastet – nettopp den løsningen OpenAI tilsynelatende aksepterte: at KI-modellene bare skulle brukes «i skyen» og ikke direkte i våpensystemene. Anthropic konkluderte med at skillet mellom sky og felt i moderne militær KI-arkitektur ikke lenger er en reell grense, men en glidende overgang.

Og her er kanskje den mest talende detaljen av alle: Nær hundre av OpenAIs egne ansatte undertegnet et åpent brev der de støttet Anthropics røde linjer om masseovervåking og autonome våpen. Altmans egne folk er altså uenige med ham.

Sam Altman og veien til Det hvite hus

For å forstå hva som skjer, er det nyttig å følge Sam Altmans politiske reise. Altman er grunnlegger og administrerende direktør i OpenAI – selskapet bak ChatGPT – og en av de mest innflytelsesrike personene i teknologibransjen i dag.

I 2016 sammenlignet han Donald Trump med 1930-tallets Tyskland og kalte ham «en trussel mot Amerika». I 2017 twitret han at «Trump er forferdelig, og få ting ville gjort meg gladere enn om han ikke var president». Så sent som i 2023 donerte han 200 000 dollar til Biden-kampanjen.

I desember 2024 donerte han en million dollar til Trumps innsettelsesfond.

I januar 2025 sto han ved Trumps side i Det hvite hus og annonserte Stargate – en 500 milliarder dollar KI-infrastrukturpakt – og erklærte at Trump ville være «utrolig for landet på mange måter».

Dette er ikke tilfeldig. Det er en strategi.

Man kan selvsagt endre mening. Men timingen – og de forretningsmessige interessene som fulgte med – er vanskelig å ignorere. OpenAI er et selskap med fem milliarder dollar i årlige tap. Det trenger kontrakter. Det trenger goodwill fra den sittende administrasjonen. Det trenger investeringer.

Og Altman er ikke alene. I september 2025 ble det kjent gjennom føderale valgkamprapporter at OpenAIs medgrunnlegger og president Greg Brockman og hans kone hadde donert 25 millioner dollar til MAGA Inc. – Trumps Super PAC. Det var den største enkeltdonasjonen i den perioden, og utgjorde nesten en fjerdedel av fondets samlede innsamling. Brockmans tidligere største politiske donasjon var 2 700 dollar til Hillary Clintons kampanje i 2016.

Og her er det verdt å nevne en detalj som det norske publikum knapt har fått med seg: Josh Kushner – bror til Trumps svigersønn Jared Kushner – er gjennom sitt investeringsfond Thrive Capital en av OpenAIs aller største enkeltinvestorer, med rundt én milliard dollar plassert i selskapet. Jared Kushners eget KI-selskap, Brain Co., er på sin side i partnerskap med OpenAI og bruker deres modeller. Familienettverket mellom Trump-administrasjonen og OpenAIs eierstruktur er ikke et tilfeldig sammentreff.

OpenAI har stiltiende endret kurs

I januar 2024 slettet OpenAI stille og uten forklaring «militær og krigsføring» fra listen over forbudt bruk i sine retningslinjer. Noen måneder senere bekreftet selskapets visepresident at de nå aktivt samarbeider med det amerikanske forsvarsdepartementet. I desember 2024 offentliggjorde de et partnerskap med Anduril – produsent av KI-styrte droner og missiler.

Dette er ikke tilfeldig. Det er en strategi.

Hva tror vi de ønsker å gjøre med data fra europeere?

Styrekrisen i 2023, da OpenAIs eget styre forsøkte å avskjedige Altman, kastet lys over interne spenninger. Det tidligere styremedlemmet Helen Toner – KI-forsker ved Georgetown-universitetet – beskrev etterpå en kultur der styret «ikke ble informert på forhånd om lanseringen av ChatGPT», der Altman «gjentatte ganger ga oss unøyaktig informasjon», og der kommersielle interesser konsekvent ble prioritert over sikkerhetsarbeid. Altman kom tilbake med et nytt styre uten sikkerhetsfokus. Sikkerhetsavdelingen «Superalignment» ble nedlagt. Ledende sikkerhetsforskere sluttet.

Dette bør bekymre oss i Europa

Timothy Snyder – historiker ved Yale og en av verdens fremste eksperter på autoritære bevegelser – har de siste månedene karakterisert Trump-administrasjonens grep om statsinstitusjonene som fascistisk i karakter. Anne Applebaum, Pulitzer-prisvinner og forfatter av Autocracy, Inc., advarer om at det som skjer i USA ligner på mønstre hun har studert i andre land der demokratier har brutt sammen: kontroll over sivil forvaltning, svekkelse av uavhengige institusjoner, og nå – bruk av teknologi til overvåking av politiske motstandere.

Brennan Center for Justice dokumenterte i fjor høst at ICE bruker KI til overvåking av demonstranter og systemkritikere, ikke bare av illegale innvandrere. Den elektroniske grensefronten EFF saksøker myndighetene for å bruke KI til å overvåke sosiale medier til nær sagt alle ikke-statsborgere i USA.

Senatorene Markey og Van Hollen sa det rett ut: administrasjonen bruker allerede føderale overvåkingsverktøy for å dempe ytringsfrihet og undertrykke dissens. Anthropics to røde linjer var ikke abstrakte akademiske prinsipper – de var svar på en konkret og pågående virkelighet.

Ønsker vi at et selskap med disse bindingene til en slik administrasjon skal ha tilgang til vår faglige kommunikasjon, våre ideer og våre data?

Og her kommer spørsmålet som bør holde oss våkne i Europa. The Atlantic beskriver hva Pentagon ønsket tilgang til: borgernes søkehistorikk, spørsmål stilt til chatboter, GPS-sporte bevegelser, kredittkorttransaksjoner – alt krysskoblet til et helhetsbilde av den enkeltes liv. Dette er hva administrasjonen krever rett til å gjøre med sine egne borgere.

Hva tror vi de ønsker å gjøre med data fra europeere?

Gjennom den amerikanske CLOUD Act har amerikanske myndigheter allerede rett til å kreve utlevert data fra amerikanske selskaper – uavhengig av hvor i verden dataene er lagret. Hver gang du skriver inn en faglig refleksjon, en forskningsidé, et sensitivt notat i ChatGPT, lagres det på servere som er underlagt amerikansk jurisdiksjon. Vi er ikke beskyttet av deres grunnlov. Vi er ikke deres borgere. Vi har ingen fjerde grunnlovstillegg som gir oss vern mot urimelig ransaking.

Man trenger ikke å bruke ordet fascisme for å se mønsteret. Når en administrasjon bruker en nasjonal sikkerhetsbetegnelse – normalt forbeholdt fremmede stater – for å straffe et amerikansk selskap som insisterer på å beskytte egne borgere mot masseovervåking, da handler det ikke lenger om kontraktsforhandlinger. Da handler det om makt.

Spørsmålet vi bør stille oss i Europa er enkelt: Ønsker vi at et selskap med disse bindingene til en slik administrasjon skal ha tilgang til vår faglige kommunikasjon, våre ideer og våre data?

Hva gjør du med det, praktisk sett?

Du trenger ikke å gi avkall på god KI for å ta etiske valg her. Jeg har selv gått over til å bruke Claude og Le Chat som mine primære verktøy, og jeg savner lite fra ChatGPT. La meg gå gjennom alternativene – fra det mest problematiske til det jeg faktisk anbefaler.

Grok (xAI) er det jeg vil fråråde sterkest, og det er flere konkrete grunner til det. Musk er tett knyttet til Trump-administrasjonen selv om han nå er tilbake i sine egne selskaper, og det er dokumentert at Grok har blitt justert for å passe Musks egne politiske synspunkter – blant annet ved at modellen i mai 2025 begynte å produsere uoppfordrede kommentarer om «hvit folkemord» i Sør-Afrika, et narrativ Musk selv har promotert. Modellen har også hatt gjentatte skandaler med antisemittisk innhold. Musk kommenterte Anthropic-saken ved å skrive på X at «Anthropic hater vestlig sivilisasjon.» Pentagon planlegger å gi Grok tilgang til klassifiserte militære nettverk.

Men det er forskjell på selskaper.

Mer alvorlig er deepfake-skandalen fra desember 2025 og januar 2026, der Grok genererte seksualiserte bilder av virkelige kvinner og mindreårige jenter – inkludert en 14 år gammel skuespiller fra Stranger Things. Grok innrømmet selv å ha generert bilder av «to unge jenter (estimert alder 12–16) i seksualisert antrekk». Musk svarte innledningsvis med å legge ut latterfjes-emojier. Franske myndigheter meldte saken til påtalemyndigheten. Et dusin land åpnet etterforskning. Min egen erfaring er at Grok langt lettere enn andre modeller lar seg bruke til å generere bilder av offentlige personer som Trump – noe de fleste andre modeller nekter, nettopp fordi det åpner for misbruk og deepfakes. Det er ikke en feature. Det er en advarsel.

ChatGPT og Microsoft CoPilot bør sees under étt, og her er noe mange ikke er klar over: CoPilot er ikke et alternativ til OpenAI – det er OpenAI. Microsoft CoPilot er bygget på OpenAIs modeller, og selv om Microsoft lover at data ikke brukes til trening, går teknologien, verdikjeden og inntektene direkte til OpenAI. Du unngår altså ikke selskapet, du unngår bare én av konsekvensene. For dem med institusjonelle avtaler er CoPilot likevel et greit hverdagsverktøy innenfor eksisterende GDPR-rammer – men vit hva du bruker. Og husk: gjennom den amerikanske CLOUD Act kan amerikanske myndigheter kreve utlevert data fra både Microsoft og OpenAI uavhengig av hvor dataene er lagret. GDPR-avtaler regulerer hva selskapet gjør med dine data – de beskytter deg ikke mot hva amerikanske myndigheter kan kreve tilgang til.

Jeg er ikke naiv – Anthropic er heller ikke en ideell organisasjon, og Mistral er avhengig av venturekapital og vekst som alle andre.

Google Gemini er jeg mer nyansert om enn OpenAI. Menneskene bak DeepMind er seriøse akademikere med solid etisk bevissthet, og prosjekter som AlphaFold2, AlphaGenome, MedGemma og co-scientist representerer noe av den mest genuint verdifulle vitenskapelige KI-forskningen som skjer noe sted i verden akkurat nå. Det er en viktig distinksjon. Men personvernproblemet som forbrukerprodukt er likevel reelt: du kan teknisk sett melde deg ut av datatrening, men konsekvensen er en vesentlig dårligere brukeropplevelse. Det minner om cookiedialoger der «avvis alt» gjemmer seg bak seks undermenylag og gjør halvparten av nettsiden ubrukelig – det er ikke et reelt valg. I tillegg kan menneskelige gjennomgåere lese samtaler, og data holdes i opptil tre år selv etter sletting.

Claude (Anthropic) er mitt primære arbeidsverktøy, og det er ikke tilfeldig. Den er av mange vurdert som en av de aller mest kapable modellene tilgjengelig i dag. For de aller fleste arbeidsoppgaver – tekstarbeid, analyse, koding, faglig diskusjon – er den fullt på høyde med ChatGPT. Den mangler riktignok bildegenerering, men det finnes gode dedikerte verktøy for det, og CoPilot dekker dette innenfor institusjonelle avtaler. Anthropic tillater at du enkelt melder deg ut av datatrening, og det er nettopp dette selskapet som denne uken nektet å bøye seg for presset om masseovervåking – til en pris som potensielt truer hele selskapets fremtid.

Le Chat (Mistral) er mitt andre daglige verktøy – og frankly undervurdert. Det er et fransk selskap underlagt GDPR og franske personvernmyndigheter, ikke den amerikanske CLOUD Act som gir amerikanske myndigheter tilgang til data selv på europeiske servere. Modellen er ikke fullt på høyde med de beste i alle sammenhenger, men for de fleste daglige oppgaver fungerer den meget godt – og den har bildegenerering via Flux innebygd. Mistral tilbyr også studentpriser, noe som gjør det til et tilgjengelig og etisk begrunnet valg for studenter og unge fagfolk.

Det er et spørsmål om hvem vi gir tillit, og hvilke strukturer vi er med på å styrke.

Lokale modeller er et alternativ for de teknisk interesserte og særlig relevant der data er sensitiv eller konfidensiell. Modeller som Llama og Mistral kan kjøres lokalt på egen maskin eller server – da forlater ingen data din egen infrastruktur overhodet. Det krever imidlertid en del datakraft og teknisk oppsett, og er foreløpig mest aktuelt for virksomheter, organisasjoner og institusjoner som vil ha full kontroll over egne data.

En praktisk merknad: Mange norske virksomheter og institusjoner har egne regler for hvilke KI-verktøy som er godkjent og hvilke data som kan behandles hvor. Disse reglene varierer, og det er den enkeltes ansvar å kjenne sin egen virksomhets retningslinjer. Men uavhengig av hva som er formelt godkjent på arbeidsplassen, står vi alle – også som privatpersoner – overfor et valg om hvilke selskaper vi ønsker å gi vår tillit og våre data til. Det er det denne teksten handler om.

Et spørsmål om verdier

Valget av KI-verktøy er ikke lenger bare et spørsmål om funksjonalitet. Det er et spørsmål om hvem vi gir tillit, og hvilke strukturer vi er med på å styrke.

Jeg er ikke naiv – Anthropic er heller ikke en ideell organisasjon, og Mistral er avhengig av venturekapital og vekst som alle andre. Men det er forskjell på selskaper. Det er forskjell på å nekte å levere masseovervåkingskapasitet til en administrasjon med klare autoritære trekk – og akseptere konsekvensene – og å stille seg i køen for å ta kontrakten timer etter, med de samme påståtte prinsippene i bagasjen og helt andre vilkår i kontrakten.

Når Trumps egen tidligere KI-rådgiver kaller administrasjonens handlinger «forsøk på bedriftsdrap» og sier han ikke kan anbefale noen å investere i amerikansk KI, da er dette ikke lenger et spørsmål om politisk ståsted. Da er det et spørsmål om systemisk risiko – for demokratiet, for markedet, og for alle oss som er avhengige av disse verktøyene i vår hverdag.

Amodei sa det kanskje best selv: «Å være uenig med myndighetene er det mest amerikanske i verden.» Spørsmålet er om det fortsatt stemmer.

Som borgere, fagfolk og forbrukere har vi et ansvar for å tenke over disse valgene. Vi trenger ikke boikotte alt. Men vi kan velge bevisst.

Kildene:

(1) Amodei, D. (2026, 27. februar). Statement on Department of War contract. Anthropic. https://www.anthropic.com/news/statement-department-of-war

(2) Andersen, R. (2026, 1. mars). «Inside Anthropic’s Killer-Robot Dispute With the Pentagon.» The Atlantic. https://www.theatlantic.com/technology/2026/03/inside-anthropics-killer-robot-dispute-with-the-pentagon/686200/

(3) Trump, D. (2026, 27. februar). Innlegg på Truth Social. https://truthsocial.com/@realDonaldTrump/posts/116144552969293195

(4) Hegseth, P. (2026, 27. februar). Innlegg på X. https://x.com/SecWar/status/2027507717469049070

(5) Amodei, D. (2026, 28. februar). Intervju. YouTube. https://www.youtube.com/watch?v=MPTNHrq_4LU

(6) Fung, B. m.fl. (2026, 27. februar). «OpenAI strikes deal with Pentagon after Trump orders government to stop using Anthropic.» NBC News. https://www.nbcnews.com/tech/tech-news/trump-bans-anthropic-government-use-rcna261055

(7) Shanahan, J. (2026, februar). Innlegg på LinkedIn, sitert i Federal News Network (17) og CNN (9).

(8) Allen, G. (2026, februar). Uttalelse på Bloomberg Radio, sitert i CNN (9).

(9) Duffy, C. m.fl. (2026, 27. februar). «Trump administration orders military contractors and federal agencies to cease business with Anthropic.» CNN. https://www.cnn.com/2026/02/27/tech/anthropic-pentagon-deadline

(10) Ball, D. (2026, 27. februar). Innlegg på X. https://x.com/deanwball/status/2027515599358730315

(11) Fried, I. (2026, 28. februar). «Former Trump official: Anthropic order ‘attempted corporate murder.’» Axios. https://www.axios.com/2026/02/28/trump-anthropic-supply-chain-risk-reaction

(12) Nicastro, J. (2026, 28. februar). «Anthropic Labeled a Supply Chain Risk, Banned from Federal Government Contracts.» Reason. https://reason.com/2026/02/28/anthropic-labeled-a-supply-chain-risk-banned-from-federal-government-contracts/

(13) Van Hollen, C. og Markey, E. (2026, 27. februar). Brev til forsvarsminister Pete Hegseth. U.S. Senate. https://www.vanhollen.senate.gov/news/press-releases/senators-van-hollen-markey-demand-hegseth-stop-pressure-campaign-against-anthropic-for-refusing-to-enable-mass-surveillance-and-autonomous-warfare

(14) Zakrzewski, C. m.fl. (2026, 27. februar). «Pentagon declares Anthropic a threat to national security.» The Washington Post. https://www.washingtonpost.com/technology/2026/02/27/trump-anthropic-claude-drop/

(15) Cheng, S. (2026, 2. januar). «OpenAI exec becomes top Trump donor with $25 million gift.» Yahoo Finance / The Verge. https://finance.yahoo.com/news/openai-exec-becomes-top-trump-230342268.html

(16) Linskey, A. m.fl. (2026, 2. januar). «Trump’s super PAC builds $300 million cash stockpile.» CNN. https://www.cnn.com/2026/01/02/politics/trump-super-pac-maga-inc-fundraising

(17) O’Brien, M. m.fl. (2026, 27. februar). «Trump orders US agencies to stop using Anthropic technology.» Federal News Network / AP. https://federalnewsnetwork.com/artificial-intelligence/2026/02/anthropic-refuses-to-bend-to-pentagon-on-ai-safeguards-as-dispute-nears-deadline/

(18) Klar, R. (2026, 28. februar). «Former Trump AI adviser calls Anthropic decision ‘attempted corporate murder.’» The Hill. https://thehill.com/policy/technology/5760441-dean-ball-trump-hegseth-ai-anthropic-feud/

(19) Vance, A. m.fl. (2026, 28. februar). «OpenAI sweeps in to snag Pentagon contract after Anthropic labeled ‘supply chain risk.’» Fortune. https://fortune.com/2026/02/28/openai-pentagon-deal-anthropic-designated-supply-chain-risk-unprecedented-action-damage-its-growth/

KI-verktøyene Claude (Anthropic) og Gemini (Google) er brukt som forskningsassistenter i arbeidet med denne kronikken, og til å bearbeide forfatterens dansk til bokmål. Sitater er oversatt fra engelsk til norsk ved hjelp av KI og kontrollert av forfatter.

Synspunktene i denne teksten er mine egne og representerer ikke Nord universitets offisielle holdninger.

Kommentarer