EU tar grep for å regulere AI, men kan glippe.

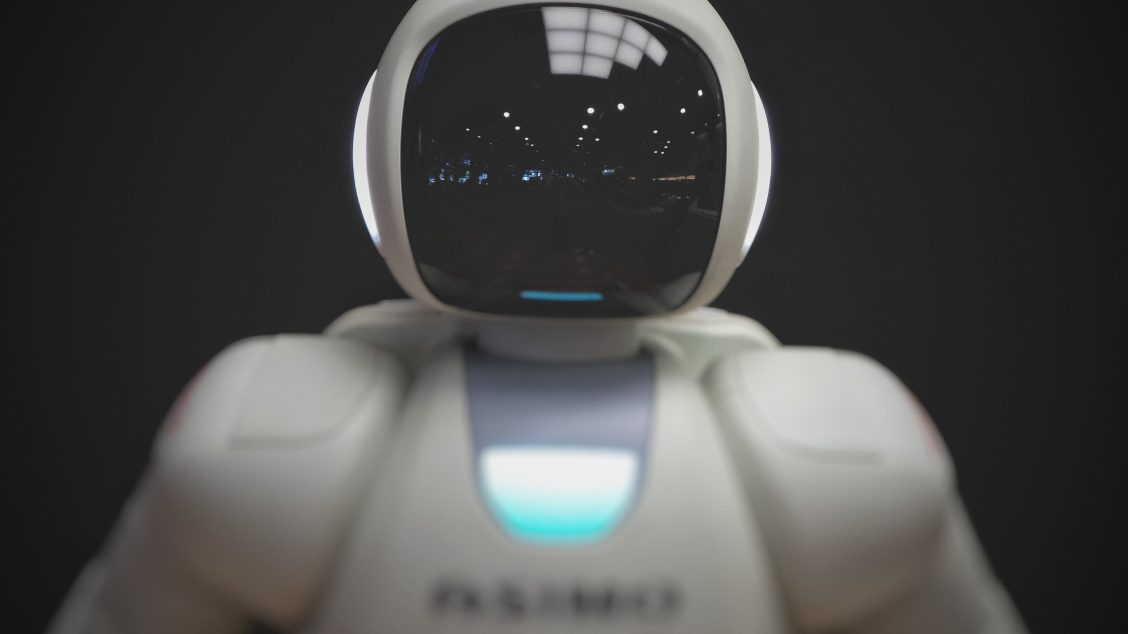

«There is no room for mass surveillance in our society», sa Margrete Vestager da hun nylig presenterte EUs forslag til regulering av kunstig intelligens. EU vil forby bruk av kunstig intelligens til masseovervåking og manipulering, og kraftig regulere det de mener er høyrisiko bruk. Men så veldig harde i klypa er EU likevel ikke.

Forslaget er både ambisiøst og omfattende. Det er ikke bare bruken som skal reguleres, «Råvarene» som puttes inn i maskinlæringssystemene er data, og derfor skal reglene også gjelde hva slags treningsdata systemene anvender. Dette er spesielt viktig for å unngå algoritmer som diskriminerer. Reguleringen skal gjelde for alle bedrifter som tilbyr AI-systemer i EU, og overtredelser skal møtes med saftige bøter.

Hva skal forbys og hva er høy risiko?

Forslaget graderer systemer for kunstig intelligens ut fra risiko.

Noe skal reguleres med forbud. Sosiale belønningssystemer som det vi har sett fra Kina skal være forbudt. Det samme skal systemer som manipulerer og utnytter sårbare grupper, og design som frister deg til å ta bestemte valg, såkalte «dark patterns».

Så veldig harde i klypa er EU likevel ikke

Den neste gruppen systemer betegnes som «høy risiko», og vil være gjenstand for egne standarder og kontroll. Blant høyrisiko nevnes systemer for nasjonal infrastruktur, utdanning, arbeid, finans og myndighetsutøvelse. Forslaget lister blant annet opp selvkjørende biler, algoritmer som brukes i ansettelselsprosesser, og systemer brukt inn i opplæring av barn.

Den tredje gruppen er stor, og omfatter all annen bruk av kunstig intelligens. Her skal reguleringen være langt mindre omfattende. EU vil for eksempel ikke bry seg om spam-filteret i eposten din. Men du skal kunne vite når du er i kontakt med en maskin, og når du snakker med et menneske av kjøtt og blod. Såkalte Deep Fakes må merkes, og du skal få tydelig beskjed når du møter en Chat-Bot.

Går foran med et eksempel

Med sine 500 millioner innbyggere er EU er et stort og viktig marked for verdens teknologibedrifter. Mange følger derfor nøye med når ny politikk lanseres. Det er også sannsynlig at EUs reguleringer vil inspirere andre land til å innføre noe tilsvarende. EU har gått foran før. Personvernreglene GDPR ble innført i 2018, og har langt på vei utviklet seg til å bli en global standard. Det viser at regulering er både mulig og nødvendig.

EUs forsøk på å lage lover for kunstig intelligens bør derfor ønskes velkommen. Men det er en reell fare for at regulering medfører en hel masse byråkrati og kontroll, uten at man oppnår ønsket resultat.

Her er noen problematiske sider ved forslaget:

Makt og demokrati-dimensjonen er i liten grad berørt

EU sier de vil sette folk først og være «human-centric». Folk skal kunne stole på at teknologien blir brukt på en trygg måte som er i tråd med lover og respekterer grunnleggende rettigheter. Folk skal informeres. Men dette er ikke nok. Det sies lite eller ingenting om hvordan de som påvirkes av AI-systemene skal kunne gå i dialog om konsekvensene det har for dem. Innsyn og åpenhet er bra, men det burde også legges til rette for at folk kan påklage avgjørelser tatt av AI-systemer, eller kunne gi innspill til forbedringer.

EU desentraliserer oppfølgingen, og legger en stor del av ansvaret for håndhevingen på den enkelte virksomheten

Et fåtalls selskaper kontrollerer og styrer utviklingen innen kunstig intelligens. Ifølge fremtidsekspert og forfatter av boken The Big Nine, Amy Webb, er det ni selskaper, seks amerikanske G-MAFIA (Google, Microsoft, Amazon, Facebook, IBM og Apple) og tre kinesiske BAT (Baidu, Alibaba og Tencent). Disse selskapene har de mest innovative forskningsavdelingene, tiltrekker seg de beste teknologene og har tilgang på de beste treningsdataene.

Hva som skjer innad i disse selskapene vil være avgjørende for hvordan kunstig intelligens utvikler seg, og fordi det dreier seg om private selskaper har offentligheten liten mulighet til innsyn og enda mindre mulighet til å påvirke viktige valg som gjøres. Nylig fikk to etikk-eksperter, Timnit Gebru og Mararet Mitchell, sparken fra Google, angivelig fordi de var kritiske til selskapets strategier og arbeid med kunstig intelligens.

EUs nye regler vil mest sannsynlig også favorisere de store selskapene. EU desentraliserer oppfølgingen, og legger en stor del av ansvaret for håndhevingen på den enkelte virksomheten. De store selskapene vil ha ressurser nok til å tilpasse seg, mens mindre bedrifter antagelig vil slite mer med å skulle følge opp de nye forpliktelsene. Dette har også vært et gjentagende problem med GDPR.

Reglene vannes ut

EU ønsker å være hard mot praksis som bryter med grunnleggende rettigheter og kan påføre mennesker psykisk og fysisk skade. Det siste har fått menneskerettighetsorganisasjoner og aktivister til å reagere. De har påpekt at det kan være vanskelig å nå gjennom med rettssaker som beviser psykisk og fysisk skade, og at det bør være nok å dokumentere brudd på grunnleggende rettigheter.

Det er også lagt inn mange nok unntak til at forbudene i praksis kan bli lite forpliktende. Et eksempel er forbudet mot bruk av ansiktsgjenkjenning i det offentlige rom.

Det er også lagt inn mange nok unntak til at forbudene i praksis kan bli lite forpliktende

Se for deg at droner utstyrt med ansiktsgjenkjenning sirkler over byen du bor i. Bilder av mistenkte er matet inn i AI-nettverket. Dersom dronen ser noen som ligner, flyr den nærmere, og er det match med bildet, gir den beskjed til den lokale politienheten som kan rykke ut og foreta en arrestasjon. I utgangspunktet vil dette antagelig rammes av forbudet. Men unntakene er flere. Politiet skal kunne bruke slike systemer til å finne en overgriper eller mistenkt hvis det dreier seg om kriminalitet med minimum tre års strafferamme. Det er også andre unntak, for eksempel skal det være lov med målrettet søk etter spesifikke ofre for kriminalitet, inkludert savnede barn.

Bruken krever en juridisk kjennelse, men gir likevel myndigheter betydelig rom for å kunne bruke kunstig intelligens til overvåking. Svært overraskende er det også at forbudet gjelder for politi, men ikke for andre, som for eksempel et privat transportselskap, en skole eller en kommune. Det er også bare overvåking i «sanntid» som forbys. Det betyr at bruken av det omstridte ClearView AI ikke rammes av forbudet. Clearview AI gjør det mulig å laste opp bilder og matche biometrien med et stort antall bilder som er samlet fra internett. Det svenske politiet har blitt bøtelagt for å ha brukt det, og også norske myndigheter er på kundelisten til Clearview.

Hva skal vi med kunstig intelligens?

Med de nye reglene for kunstig intelligens viser EU en vilje til å ha begge hender på rattet: de vil i større grad utnytte mulighetene kunstig intelligens kan gi for Europa, men går samtidig inn for relativt omfattende regulering for å hindre misbruk.

Dette er del av en ny politikk for det digitale området. EU har vedtatt en digital strategi, og en rekke nye lover som stiller krav til teknologiselskapene.

Men EU forutsetter en form for teknologidrevet utvikling. De tar for gitt at kunstig intelligens er noe vi skal drive med i stor skala, og hopper dermed bukk over det viktigste spørsmålet: Når er AI nyttig? For hvem? Hva er miljøkonsekvensene? Hvilken innvirkning har det på livene våre? Hvis EU mener alvor med å sette folk først, er det her de må starte.

Kommentarer