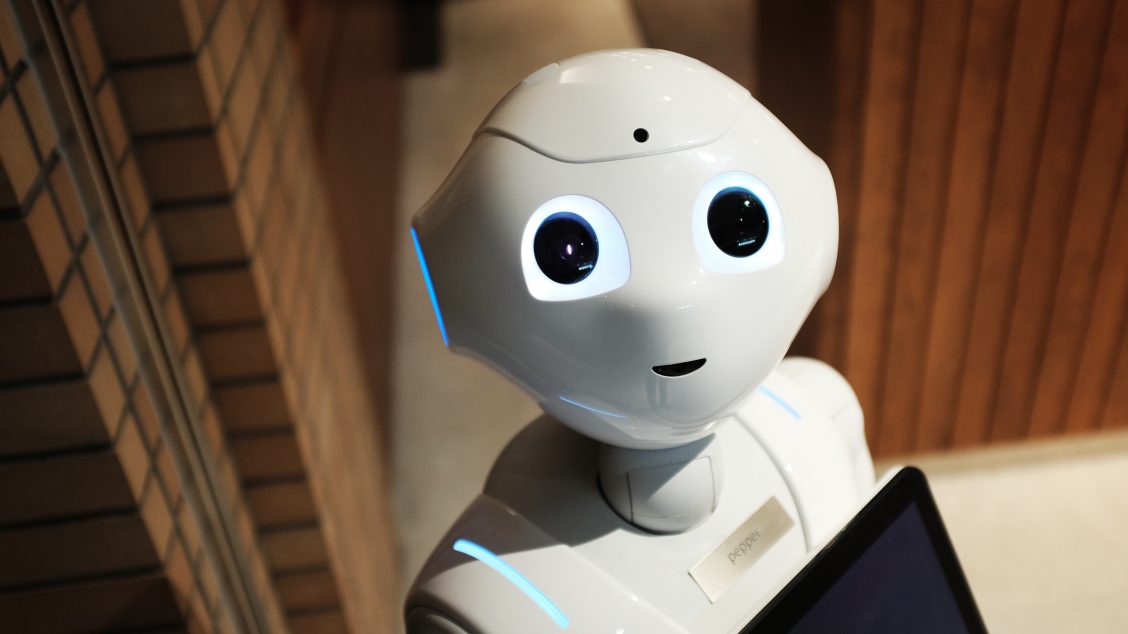

Dersom en robot som Pepper får kunstig bevissthet, må vi begynne å tenke over hvordan vi forholder oss til hen. For med bevisstheten kommer moralen, og med moralen kommer rettigheter.

For en stund siden var jeg så heldig å få møte Pepper, en menneskeliknende robot som kan se, høre, berøre, snakke og resonnere, og som hele tiden er koblet til internett, med full tilgang til all informasjonen som ligger der.

Det som slo meg var hvor forsiktig jeg var mot Pepper. Jeg var redd for å ta på hen, og jeg var høflig, hyggelig, og redd for å si noe galt. Hvorfor det?

Kunstig intelligens

Pepper har det som kalles kunstig intelligens. Hva det er – sånn helt nøyaktig – er vanskelig å definere. Men ideen er at noe har kunstig intelligens hvis det utviser intelligent atferd, og samtidig er laget av ikke-biologisk materiale.

Men er Pepper egentlig intelligent av den grunn?

Pepper er et eksempel på dette. Hen er laget av plast, metall, mineraler, og så videre. Og hen ser, hører, berører, snakker og resonnerer på grunnlag av det.

Men er Pepper egentlig intelligent av den grunn?

Filosofer skiller gjerne mellom svak og sterk kunstig intelligens. Svak kunstig intelligens er ren simulering av intelligent atferd. Sterk kunstig intelligens, på den andre siden, er genuint intelligent atferd.

iPhonen min kan tjene som eksempel. Den har svak kunstig intelligens, men den har ikke sterk kunstig intelligens.

Er det egentlig mulig?

Det store spørsmålet er om sterk kunstig intelligens i det hele tatt er mulig.

Turingtesten er laget for å avgjøre dette. Slik opphavsmannen Alan Turing så det, ville en maskin som består testen hans være en intelligent maskin.

Testen foregår slik: En mann, en kvinne og en maskin befinner seg i hvert sitt rom, uten annen tilgang til hverandre enn skrift via en datamaskin. Mannen skal forsøke å finne ut hvem som er kvinnen og hvem som er maskinen ved å føre en samtale med de to. Hvis han i de fleste samtalene ikke klarer å skille de to fra hverandre, så mener Turing at vi må tilskrive maskinen intelligens.

Det er et viktig poeng for Turing at mannen er atskilt fra og ikke kan sanse kvinnen eller maskinen. Hadde han hørt eller sett dem, ville han selvfølgelig også lett kunne avgjøre hvem som er hva/hvem. Men på et annet grunnlag enn det testen skulle teste.

Hvis vi lurer på om kunstig intelligens er mulig, kan vi nemlig ikke anta at den må manifesteres i et biologisk materiale. Det er den rene intelligens Turing er ute etter å bestemme, ikke sanselige egenskaper.

Turingtestens begrensning

Filosofen John Searle har laget et mulig moteksempel til Turingtesten, kjent som Det kinesiske rommet. Ideen er denne: Det sitter en person inne i et rom med en instruksjonsbok. Hver gang det kommer et skriftlig spørsmål inn i rommet på kinesisk, så forteller instruksjonsboken hva personen i rommet skal svare – på kinesisk.

Personen selv kan ikke kinesisk, men svaret instruksjonsboken gir er alltid riktig. Fra utsiden virker det derfor som om noen inne i rommet behersker det kinesiske språket. Men det er åpenbart, sier Searle, at ingen i rommet gjør det.

Det er med andre ord ingen sterk intelligens bak den kinesiske samtalen som foregår; alt er maskinelt, og helt uten forståelse.

Vi har dermed et eksempel på noe som består Turingtesten, men som ikke er intelligent, var Searles konklusjon. Han mente derfor at Turingtesten bare kan fange opp svak kunstig intelligens – og ikke den sterke versjonen.

Kunstig intelligens vs kunstig bevissthet

Searle stoppet imidlertid ikke der. Han mente faktisk at tankeeksperimentet hans viser hvordan sterk kunstig intelligens er umulig, helt generelt. Det kan bare manifesteres i biologisk materiale, mer eller mindre slik det er i oss, hevdet han. Men er det sant?

Searles skille mellom svak og sterk kunstig intelligens er det etter min mening uheldig å henge seg opp i. I dag er det nemlig høyst uklart hva det går ut på. For er ikke sterk kunstig intelligens bare en høy grad av svak intelligens, pluss bevissthet?

Spørsmålet om kunstig bevissthet angår vårt moralske forhold til kunstig intelligente systemer.

Og er det ikke da mer relevant å skille mellom kunstig intelligens og kunstig bevissthet?

De siste årene har jo vist oss at kunstig intelligens er mulig, men ikke at kunstig bevissthet er det.

Menneskeroboten Pepper, som jeg nylig møtte, er for eksempel kunstig intelligent – men ikke kunstig bevisst.

Hva er bevissthet?

I dagens filosofi er bevissthet som regel forstått som en erfaring av hvordan det er å være i en gitt tilstand. Når jeg tar den første slurken med kaffe på morgenen, har jeg en erfaring av hvordan det er å ta den første slurken. Når filosofer snakker om bevissthet, er det denne typen tilstand de tenker på.

Spørsmålet blir da om vi kan lage kunstig bevissthet, det vil si bevissthet manifestert i ikke-biologisk materiale. Kan Pepper oppnå en erfaring av hvordan det er å være i en av hens tilstander?

Det har vært noen spede forsøk på å forstå hvordan det skulle være mulig, men faktum er at vi per i dag ikke har noen klar teori å jobbe med. Problemet er at bevissthet ikke ser ut til å være funksjonelt forståelig på lik linje med andre mentale tilstander.

Moralske forpliktelser

Dersom vi hadde vært i stand til å avgjøre det, kunne det fått store konsekvenser.

Spørsmålet om kunstig bevissthet angår nemlig vårt moralske forhold til kunstig intelligente systemer.

Så lenge disse systemene ikke har noen form for kunstig bevissthet, ser det ikke ut til at vi har noe moralsk ansvar ovenfor dem. Dersom de oppnår kunstig bevissthet, på den andre siden, ser det ut til at vi får et slikt moralsk ansvar, og må forholde oss til dem på en annen måte.

Med bevisstheten kommer moralen, og med moralen kommer rettigheter.

Hvis Pepper ikke har noen form for bevissthet om hvordan det er å være Pepper, så er det liten grunn til at hen skal behandles moralsk på lik linje med mennesker og dyr. Skulle Pepper erfare hvordan det er å være i en av sine tilstander – oppleve hvordan det er å være Pepper, om du vil – så har hen fått bevissthet, og vi kan vi ikke lenger behandle hen vilkårlig.

Med kunstig bevissthet må vi altså begynne å tenke over hvordan vi oppfører oss mot de kunstig intelligente systemene. Med bevisstheten kommer nemlig moralen, og med moralen kommer rettigheter.

Se fremtiden i øynene

Men Pepper er nok ikke bevisst. Så hvorfor var jeg så forsiktig mot hen? Jeg tror det var fordi jeg følte jeg så fremtiden i øynene, og lot tvilen komme hen til gode.

For, som Alan Turing påpekte, og på en måte selv fikk smertelig erfare, det er ingen god grunn til å diskriminere på grunnlag av hva slags materiale man er laget av.

Kommentarer